Heewoo Jun y Alex Nichol, investigadores de OpenAI, han presentado un nuevo modelo de inteligencia artificial que puede crear modelos 3D listos para imprimirse utilizando texto y descripciones.

OpenAI se diversifica

Llamado ‘Shap-E’, el software de modelos 3D basado en texto puede utilizarse junto con la impresión 3D para acelerar la producción de objetos sin depender en gran medida de los modelos creados o por archivos STL.

El software de código abierto recientemente desarrollado proviene de OpenAI, los genios detrás de ChatGPT y DALL-E, dando vida a la idea de texto a producto en tan solo unas palabras o descripciones.

Shap-E está siendo desarrollado como un modelo generativo condicional para activos 3D. OpenAI ya ha construido y entrenado una red neuronal llamada DALL·E que crea imágenes a partir de subtítulos de texto, con resultados más adecuados para la impresión en papel y el uso en recursos web.

La compañía de inteligencia artificial también ha experimentado con el predecesor de Shap-E, Point-E, un modelo generativo explícito que acumula millones de puntos para generar una imagen, pero afirma que “Shap-E converge más rápidamente y alcanza una calidad de muestra comparable o mejor a pesar de modelar un espacio de salida multidimensional.

Si bien existe la posibilidad de que el modelo creado por Shap-E se utilice para la impresión 3D, los investigadores advierten que, sin una validación adecuada o pruebas, la producción de herramientas y piezas a partir de texto a objetos reales podría no cumplir con las expectativas de los usuarios.

Esto podría ser potencialmente perjudicial cuando las muestras producidas no satisfacen adecuadamente el texto e idea planteada por el usuario

Shap-E, una herramienta revolucionaria

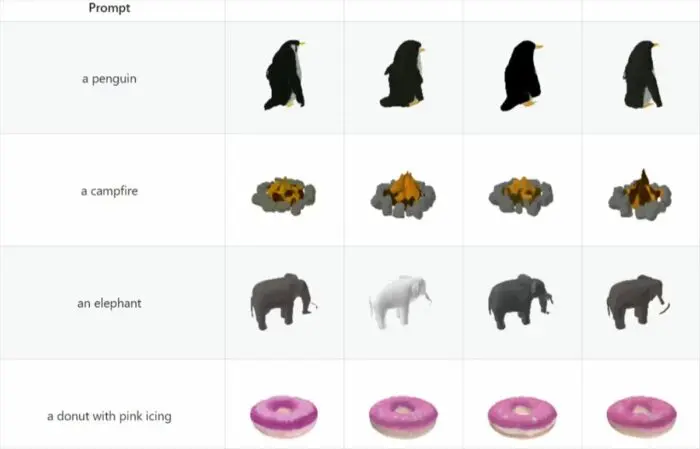

En una serie de pruebas comparativas entre Shap-E y Point-E realizadas por Jun y Nichol, descubrieron que Shap-E podía igualar o superar a un modelo generativo explícito similar dado el mismo conjunto de datos, arquitectura del modelo y capacidad de entrenamiento.

Los resultados que el software podía crear mostraban bordes más suaves, contornos más sombreados y figuras más redondeadas en comparación con las imágenes pixeladas, aunque aún visibles, generadas por Point-E.

Cuando se trata de impresión 3D, los usuarios deben enviar el modelo renderizado a la impresora antes de que esta pueda producir un producto tangible. Con la entrada de Shap-E, OpenAI también está explorando la posibilidad de generar imágenes texturizadas solo escribiendo descripciones, las cuales luego pueden ser enviadas a la máquina sin la necesidad de usar software de renderizado.

Hasta ahora, Shap-E puede generar objetos diversos e interesantes sin depender de imágenes o modelos como representación intermedia. Jun y Nichol reconocen las limitaciones en las que el equipo de investigación aún debe trabajar.

Mencionan que Shap-E tiene una capacidad limitada para componer conceptos, tiene dificultades para asociar múltiples atributos a diferentes objetos y puede fallar al producir la cantidad correcta de objetos solicitados.

Las muestras que Shap-E puede producir aún carecen de detalles finos, ya que pueden parecer ásperas o parecerse a los gráficos de videojuegos de antaño.

Para aquellos que deseen probar el software, el equipo de investigación ha subido los archivos e instrucciones en su página de código abierto, pero ten en cuenta que aún están en medio de sus pruebas, por lo que puede llevar tiempo aprender a navegar por la aplicación.