Nvidia se suma a la creación de imágenes a partir de texto con Perfusion

Nvidia ha presentado su revolucionario generador de imágenes llamado Perfusion, que impresiona al mundo tecnológico al ocupar un escaso espacio de 100KB, comparable al tamaño de un disquete clásico.

Un modelo más que eficiente

Este avance redefine los límites de la miniaturización sin comprometer el rendimiento, ya que el proceso de entrenamiento de Perfusion se ha optimizado a tal grado que ahora solo requiere 4 minutos para completarse.

Esto marca un paso adelante en la eficiencia y la velocidad del aprendizaje automático, consolidando aún más a Nvidia como líder en innovación dentro del campo de la inteligencia artificial.

En el dinámico escenario de las herramientas de creación artística basadas en IA, los expertos de Nvidia han revelado una estrategia innovadora para transformar texto en imágenes, denominada Perfusion.

Tamaño muy por debajo de sus competidores

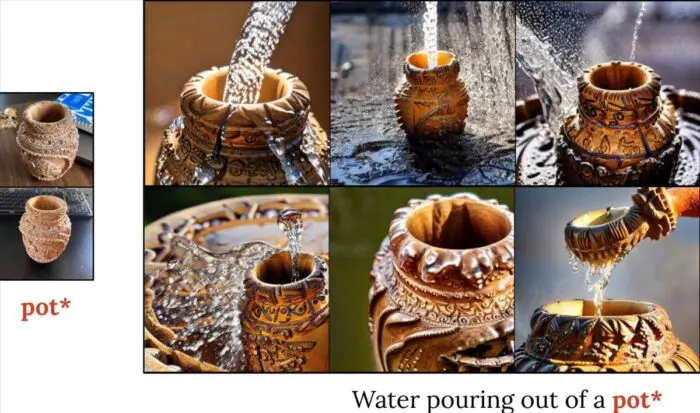

A diferencia de los modelos colosales de alto coste desarrollados por sus rivales, Perfusion se distingue por su sencillez. Con apenas 100 KB de tamaño y una velocidad de entrenamiento de solo 4 minutos, este enfoque brinda un asombroso margen de flexibilidad creativa al dar vida a conceptos personalizados sin sacrificar su esencia distintiva.

La introducción de Perfusion tuvo lugar a través de un documento de investigación desarrollado en colaboración entre Nvidia y la Universidad de Tel Aviv en Israel.

A pesar de sus dimensiones compactas, este innovador sistema logra sobresalir frente a los principales generadores de arte basados en IA, incluyendo nombres destacados como el Stable Diffusion v1.5 de Stability AI, la reciente adición Stable Diffusion XL (SDXL) y el MidJourney, al demostrar una eficiencia sin igual en la realización de ediciones específicas.

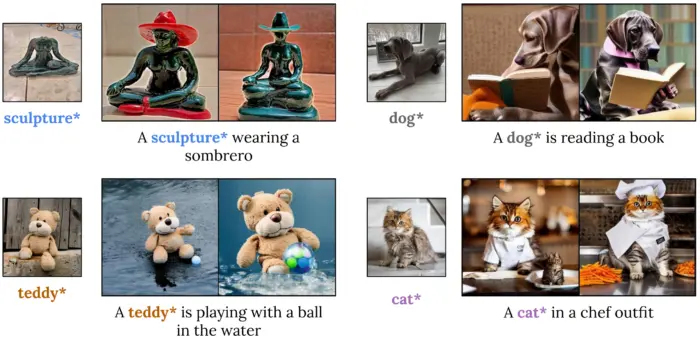

El núcleo central en el corazón de Perfusion es conocido como “Key-Locking”, una técnica que opera mediante la conexión de novedosos conceptos deseados por el usuario, como un gato específico o una silla, con categorías más generales durante el proceso de generación de imágenes.

Este enfoque resulta esencial para prevenir el sobreajuste, aquel fenómeno en el que el modelo se adhiere excesivamente a los ejemplos de entrenamiento exactos. El sobreajuste puede entorpecer la habilidad de la IA para concebir versiones frescas y creativas del concepto en cuestión.

La estrategia de la moderación

A diferencia de las herramientas actuales, que asimilan conceptos de manera aislada, Perfusion permite que los usuarios amalgamen directamente diversos elementos guiando el proceso mediante indicaciones de texto. Esto les posibilita combinar conceptos tan distintos como un gato específico y una silla en una sola imagen con coherencia.

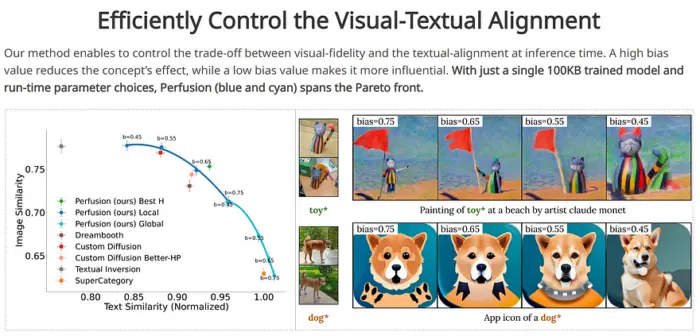

Una de las características sobresalientes de Perfusion consiste en su capacidad para otorgar a los usuarios el control absoluto sobre el equilibrio entre la fidelidad visual de la imagen y la coherencia textual de la indicación durante el proceso de inferencia.

Todo esto se logra mediante la manipulación de un único modelo de 100KB. Esta innovación permite a los usuarios explorar con facilidad la frontera de Pareto, donde se sopesa la similitud entre el texto y la imagen.

Esta característica capacita a los usuarios para elegir el compromiso ideal que mejor se ajuste a sus necesidades, sin la necesidad de volver a someter al modelo a un proceso de entrenamiento.

El entrenamiento del modelo

Es de vital importancia comprender que la tarea de entrenar un modelo es una habilidad que requiere sutileza. Enfocarse excesivamente en reproducir exactamente el modelo puede resultar en una producción repetitiva de la misma salida una y otra vez.

Del mismo modo, forzar al generador a adherirse demasiado rígidamente a la indicación, sin permitirle cierta libertad, generalmente conlleva a resultados insatisfactorios. La capacidad de ajustar con qué proximidad el generador se acerca a la indicación emerge como un componente esencial para lograr una personalización efectiva.

Mientras que otros generadores de imágenes basadas en IA brindan métodos para que los usuarios ajusten el producto final, estos enfoques suelen ser pesados. Por ejemplo, la técnica de ajuste fino conocida como LoRA, ampliamente utilizada en Stable Diffusion, puede añadir desde decenas de megabytes hasta más de un gigabyte (GB) al tamaño de la aplicación.

Grandes diferencias de tamaños vs otras IAs

Por otra parte, las incrustaciones de inversión textual, aunque más livianas, tienden a ser menos precisas. Un contraste notable lo proporciona el método Dreambooth, actualmente considerado el más preciso, cuyo modelo entrenado alcanza un peso superior a los 2GB.

En contraste, Nvidia sostiene que Perfusion logra un nivel de calidad visual y coherencia con las indicaciones que supera a las técnicas líderes en IA mencionadas anteriormente.

La dimensión extremadamente eficiente de Perfusion permite actualizar únicamente las partes necesarias al ajustar el proceso de generación de imágenes, a diferencia de los métodos que afinan minuciosamente todo el modelo, cuya huella abarca varios gigabytes.

Esta investigación se alinea con la creciente dedicación de Nvidia al ámbito de la inteligencia artificial. Durante el transcurso de 2023, las acciones de la compañía han experimentado un incremento del 230%, impulsadas por la continua supremacía de sus unidades de procesamiento gráfico (GPU) en el ámbito del entrenamiento de modelos de IA.

Con actores como Anthropic, Google, Microsoft y Baidu invirtiendo considerables sumas en la IA generativa, el modelo innovador de Nvidia, Perfusion, podría conferirle una ventaja significativa.