Las Inteligencias Artificiales como Bard o ChatGPT siguen sin ser perfectas y no debemos confiar por completo en ellas

Las inteligencias artificiales lanzadas hasta este momento han presentado diferentes problemas, ahora, se está abordando la problemática de “alucinaciones” por parte de estas herramientas considerando que no brindan información actualizada.

El mes pasado, antes de la coronación del rey Carlos III el 6 de mayo, se produjo un resultado sorprendente en una solicitud de información hecha a ChatGPT. El chatbot de inteligencia artificial (IA) desarrollado por OpenAI presentó el siguiente párrafo:

La coronación tuvo lugar en la Abadía de Westminster, en Londres, el 19 de mayo de 2023. La abadía ha sido el escenario de las coronaciones de los monarcas británicos desde hace siglos y se considera uno de los lugares más sagrados y emblemáticos del país.

Este párrafo ejemplifica lo que se conoce como una “alucinación” en el contexto de la IA. Se refiere a información generada por el sistema que, aunque se presenta de manera coherente, contiene datos incorrectos, sesgados o completamente erróneos.

La coronación programada para Carlos III estaba prevista para el 6 de mayo, sin embargo, por alguna razón, ChatGPT llegó a la conclusión equivocada de que tendría lugar el día 19 de mayo.

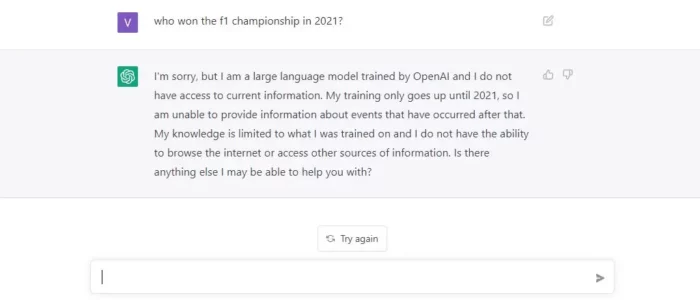

ChatGPT no tiene información acceso a información actualizada

El sistema advierte que solo puede generar respuestas basadas en información disponible en internet hasta septiembre de 2021, lo que puede resultar en este tipo de problemas al proporcionar respuestas a consultas.

En el lanzamiento de la versión GPT-4 del chatbot el pasado marzo, OpenAI explicó que GPT-4 todavía tiene varias limitaciones conocidas en las que estamos trabajando para abordar, como prejuicios sociales, alucinaciones e indicaciones contradictorias.

Sin embargo, este fenómeno no es exclusivo del sistema de OpenAI, sino que también se presenta en otros chatbots de IA, como Bard de Google y otros sistemas similares que han sido lanzados recientemente al público.

Recientemente, periodistas de The New York Times sometieron a ChatGPT a una prueba sobre la primera vez que el diario publicó un artículo sobre IA. El chatbot proporcionó varias respuestas, algunas de las cuales contenían datos incorrectos o “alucinaciones”.

“Los chatbots se basan en una tecnología llamada modelo de lenguaje grande (LLM), que aprende sus habilidades analizando grandes cantidades de texto digital extraído de internet”, explicaron los autores del artículo para el Times.

“Al identificar patrones en esos datos, un LLM aprende a realizar una tarea en particular: predecir la siguiente palabra en una secuencia de palabras. Funciona como una versión potente de una función de autocompletar”, continuaron.

Sin embargo, debido a que la red está “llena de información falsa, la tecnología aprende a repetir esas falsedades”, advirtieron. “Y a veces, los chatbots inventan cosas”.

Es importante tener precaución

Los expertos advierten que los algoritmos de IA generativa y de aprendizaje de refuerzo son capaces de procesar enormes cantidades de información de internet en cuestión de segundos y generar nuevo texto que, en su mayoría, es coherente y está redactado de manera impecable. Sin embargo, es necesario tomarlo con cautela.

Tanto Google como OpenAI han instado a los usuarios a tener esto en cuenta.

En el caso de OpenAI, que tiene una asociación con Microsoft y su motor de búsqueda Bing, señalan que GPT-4 tiene la tendencia a alucinar, es decir, producir contenido sin sentido o falso en relación con ciertas fuentes.

“Esta tendencia puede ser especialmente perjudicial a medida que los modelos se vuelven cada vez más convincentes y creíbles, lo que lleva a que los usuarios depositen demasiada confianza en ellos”, explicó la empresa en un documento adjunto al lanzamiento de su nueva versión del chatbot.

Por lo tanto, los usuarios no deben confiar ciegamente en las respuestas que ofrece, especialmente en áreas que involucren aspectos importantes de sus vidas, como consejos médicos o legales.

OpenAI destaca que ha trabajado en una variedad de métodos para evitar que las “alucinaciones” se produzcan en las respuestas a los usuarios, incluyendo la revisión realizada por personas reales para evitar datos erróneos, sesgos raciales o de género y la propagación de noticias falsas.