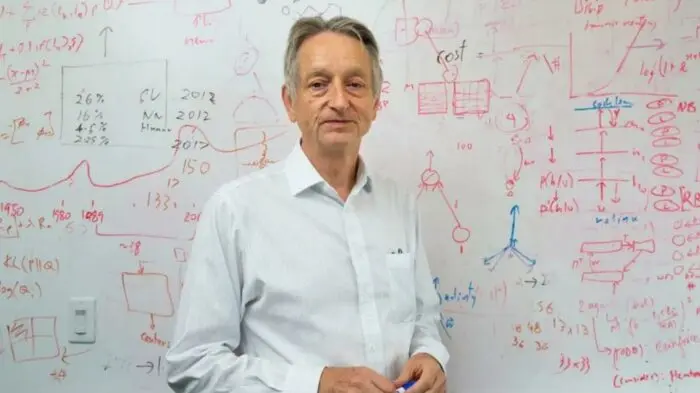

Geoffrey Hinton, el padrino de la Inteligencia Artificial ha renunciado a Google

Geoffrey Hinton, quien es conocido como el “padrino de la inteligencia artificial“, anunció este lunes que renunció a su puesto en Google la semana pasada para alertar sobre los riesgos de la tecnología que ayudó a crear.

El “Padrino” de la IA renuncia a Google

El trabajo pionero de Hinton en redes neuronales sentó las bases para los sistemas de inteligencia artificial que impulsan muchos de los productos actuales. Durante una década, trabajó a tiempo parcial en Google desarrollando tecnología de inteligencia artificial, pero ahora está preocupado por el impacto de la tecnología y el papel que desempeñó en su desarrollo.

En una entrevista con The New York Times, quien fue el primero en informar sobre su decisión, Hinton dijo: “Trato de consolarme con la excusa común de que, si no lo hubiera hecho yo, alguien más lo habría hecho“.

Geoffrey Hinton publicó un tuit el lunes en el que explicaba que renunció a Google no para criticar específicamente a la compañía, sino para poder hablar libremente sobre los peligros de la inteligencia artificial (IA).

Google va por buen camino

Hinton afirmó que “se fue para poder hablar sobre los peligros de la IA sin tener en cuenta cómo esto afecta a Google”, y añadió que Google ha actuado de manera responsable. Jeff Dean, científico jefe de Google, expresó su gratitud por las contribuciones de Hinton a lo largo de una década y afirmó que la compañía sigue comprometida con un enfoque responsable de la IA.

La renuncia de Hinton y sus preocupaciones sobre la IA surgen en un momento en que cada vez más legisladores, grupos de defensa y expertos en tecnología están preocupados por el potencial de los chatbots impulsados por la IA para difundir información errónea y desplazar empleos.

La atención generada por ChatGPT a finales del año pasado ha reavivado la carrera de las empresas tecnológicas para desarrollar e implementar herramientas de IA similares en sus productos. Aunque OpenAI, Microsoft y Google lideran esta tendencia, IBM, Amazon, Baidu y Tencent también están trabajando en tecnologías similares.

En marzo, algunas personalidades destacadas del mundo tecnológico firmaron una carta instando a los laboratorios de inteligencia artificial a detener el entrenamiento de los sistemas más potentes durante al menos seis meses debido a los “profundos riesgos para la sociedad y la humanidad”.

La carta fue publicada por el Future of Life Institute, una organización sin ánimo de lucro respaldada por Elon Musk, apenas dos semanas después de que OpenAI anunciara GPT-4, una versión aún más potente de la tecnología detrás de ChatGPT.

En las primeras pruebas y en una demostración de la empresa, GPT-4 se utilizó para redactar demandas, aprobar exámenes estandarizados y crear un sitio web funcional a partir de un boceto dibujado a mano.

Preocupación genuina sobre la IA

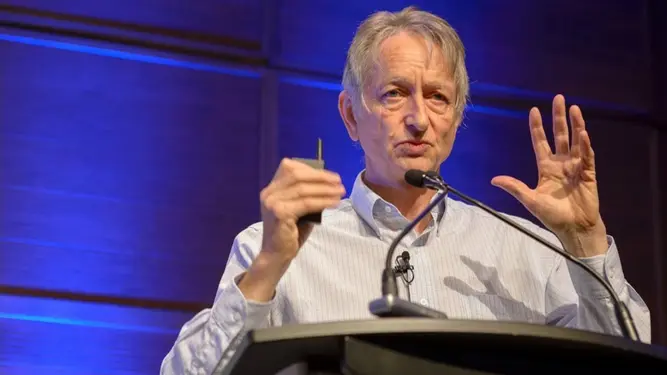

En esta misma entrevista, Hinton compartió su preocupación sobre el potencial de la inteligencia artificial para eliminar puestos de trabajo y crear un mundo en el que muchas personas “ya no serán capaces de saber qué es verdad”. También señaló el asombroso ritmo de avance, mucho más allá de lo que él y otros habían previsto.

“La idea de que estas cosas pudieran llegar a ser más inteligentes que las personas, unos pocos lo creían”, dijo Hinton en la entrevista. “Pero la mayoría pensaba que no era así. Y yo también. Pensaba que faltaban de 30 a 50 años o incluso más. Obviamente, ya no pienso eso”.

Incluso antes de apartarse de Google, Hinton había hablado públicamente sobre el potencial de la IA para hacer tanto daño como bien.

Más funcionalidades y peligros a la vista

“Creo que el progreso rápido de la IA va a transformar la sociedad de formas que no comprendemos del todo y no todos los efectos van a ser buenos”, dijo Hinton en un discurso de apertura de 2021 en el Instituto Indio de Tecnología de Bombay.

Señaló que la IA impulsará la atención sanitaria, pero también creará oportunidades para las armas autónomas letales. “Esta perspectiva me parece mucho más inmediata y mucho más aterradora que la de que los robots tomen el control, que creo que está muy lejos”.

Hinton no es el primer empleado de Google en sonar las alarmas sobre la IA. En julio, la empresa despidió a un ingeniero que afirmaba que un sistema de IA aún no publicado se había vuelto consciente, alegando que había infringido las políticas de empleo y de seguridad de datos.