xAI desafía a OpenAI con Colossus equipado con cien mil GPUs

Elon Musk ha dado un nuevo impulso al desarrollo de la inteligencia artificial (IA) con su startup xAI, que lanzó en julio. La compañía ha completado la configuración de Colossus, un sistema de entrenamiento de IA que Musk ha descrito como “el más poderoso del mundo”.

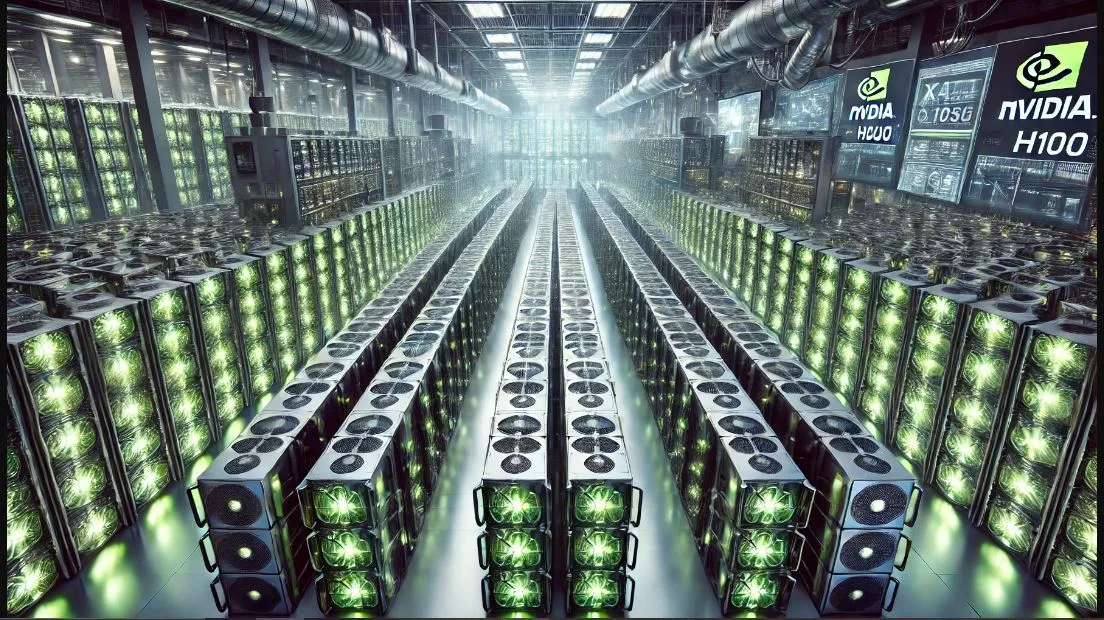

Nvidia detrás del superordenador de xAI

Este supercomputador está impulsado por 100,000 unidades de procesamiento gráfico (GPU) Nvidia H100, con planes de ampliar su capacidad a 200.000 en los próximos meses, según Musk en su plataforma X.

Entre ellas, 50.000 serán del modelo más avanzado, el H200 de Nvidia. Musk agradeció el esfuerzo del equipo y de sus colaboradores, entre ellos Nvidia, a través de una publicación citada por Quartz.

El objetivo principal de Colossus es entrenar el nuevo modelo de lenguaje grande (LLM) de xAI, llamado Grok, con el cual buscan competir directamente con el GPT-4 de OpenAI. Musk anunció que Grok-3 estará listo para diciembre.

Inversión millonaria para el desarrollo de Colossus

En junio, xAI seleccionó Memphis, Tennessee, como la sede de su supercomputadora, con la colaboración de empresas como Dell Technologies y Super Micro Computer. El CEO de Dell, Michael Dell, celebró este logro en X, destacando el orgullo de la empresa por participar en este proyecto revolucionario.

Después en mayo, xAI recaudó seis mil millones de dólares en una ronda de financiación Serie B, con inversionistas destacados como Andreessen Horowitz y Sequoia Capital, lo que elevó la valoración de la startup a 24 mil millones de dólares.

A pesar de estos avances, la empresa enfrenta críticas en Memphis por el uso de turbinas de gas, lo que ha generado preocupación por la contaminación atmosférica, según Silicon Angle. Organizaciones ambientalistas han solicitado al departamento de salud que investigue si xAI está operando sin los permisos necesarios y que detenga sus actividades hasta obtener la autorización requerida.

¿xAI destacará pronto en la industria de la IA?

Silicon Angle también destacó que Colossus ha superado a otros sistemas de IA, como el Aurora del Departamento de Energía de EE.UU., al alcanzar una velocidad máxima de 10.6 exaflops en una prueba realizada en mayo.

Musk explicó en X que Colossus cuenta con 100.000 GPUs Nvidia H100, que representan una mejora significativa gracias a su módulo Transformer Engine, optimizado para modelos de arquitectura Transformer.

El modelo H200 también equipada en Colossus promete ser aún más rápido, gracias a avances como la memoria HBM3e y una capacidad de almacenamiento aumentada a 141 GB, lo que acelera considerablemente la transferencia de datos y mejora el rendimiento de los modelos de IA.

Fuente: Fortune