OpenAI revoluciona ChatGPT con modo de voz avanzado y GPT-4o

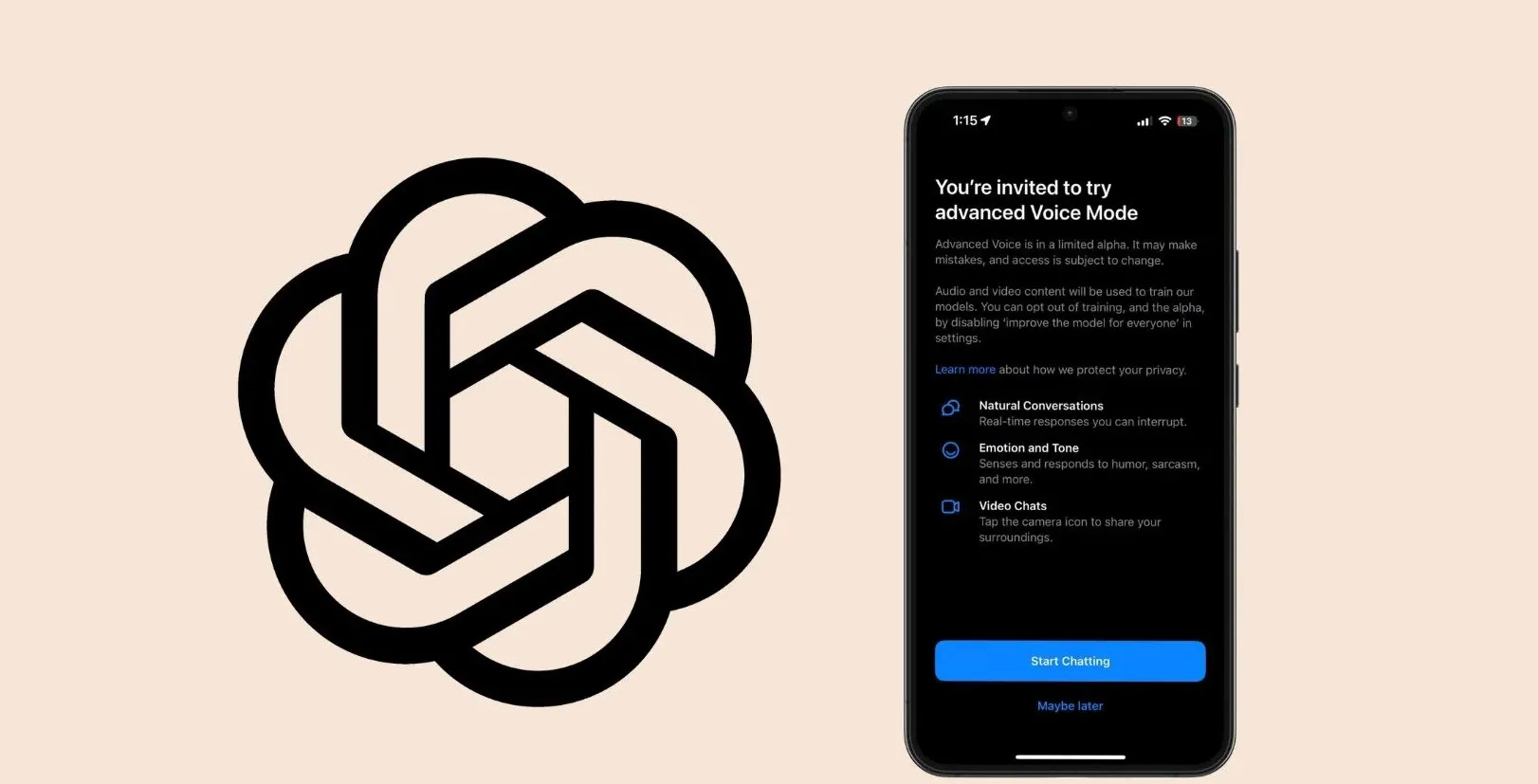

OpenAI ha dado un gran paso en la evolución de ChatGPT al lanzar un modo de voz avanzado para un grupo selecto de usuarios.

Esta nueva función, que permite conversaciones fluidas y naturales en tiempo real, marca un hito en la interacción humano-máquina.

Conversaciones más naturales

Gracias a la tecnología de reconocimiento de voz y procesamiento del lenguaje natural, ChatGPT ahora puede entender y responder a comandos de voz, ofreciendo una experiencia más intuitiva y personalizada.

Los usuarios podrán interrumpir en cualquier momento y el chatbot incluso detectará y responderá a sus emociones.

OpenAI ha priorizado la privacidad y la seguridad en el desarrollo de esta nueva función. El modelo de voz ha sido entrenado para utilizar solo cuatro voces preestablecidas y cuenta con sistemas de protección para evitar la generación de contenido inapropiado o que infrinja derechos de autor.

We’re starting to roll out advanced Voice Mode to a small group of ChatGPT Plus users. Advanced Voice Mode offers more natural, real-time conversations, allows you to interrupt anytime, and senses and responds to your emotions. pic.twitter.com/64O94EhhXK

— OpenAI (@OpenAI) July 30, 2024

GPT-4o: un salto cuántico

El modo de voz avanzado es solo una de las novedades que trae GPT-4o, la última versión del modelo de lenguaje de OpenAI. En el futuro, ChatGPT también podrá interpretar imágenes y realizar otras tareas complejas, ampliando aún más sus capacidades.

Recordemos que OpenAI ha liberado algunas funciones de su modelo Plus a cuentas gratuitas, desde luego, de manera limitada, pero buscando atraer a más personas a pagar por un chatbot más capaz.

OpenAI está recopilando datos de las pruebas para mejorar continuamente el modo de voz y otras funciones de GPT-4o. Próximamente, la empresa publicará un informe detallado sobre las capacidades y limitaciones del modelo.

Fuente: Engadget